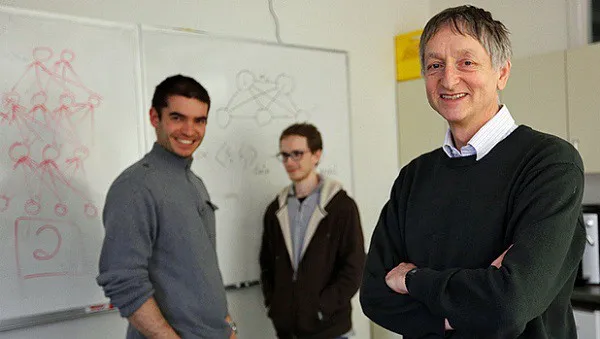

Ilya Sutskever und Geoffrey Hinton, zwei Verfechter der sicheren KI

Diese Woche sprechen wir über zwei Schlüsselfiguren in der Welt der KI, Ilya Sutskever und Geoffrey Hinton, der kürzlich den Nobelpreis für Physik erhalten hat. Beide haben sich ein Ziel gesetzt: vor den Gefahren der KI zu warnen und zu versuchen, etwas Positives zu tun, damit die künstliche Intelligenz wirklich zum Wohle der Menschheit und nicht gegen uns eingesetzt wird.

Die sichere Superintelligenz von Ilya Sutskever erreicht eine Bewertung von 32 Mrd.

Safe Superintelligence, das von Ilya Sutskever gegründet wurde, nachdem er OpenAI aufgrund von Sicherheitsbedenken verlassen hatte, hat eine Bewertung von 32 Mrd. USD erreicht. Das Unternehmen widmet sich ausschließlich der Entwicklung einer “sicheren Superintelligenz” ohne unmittelbaren kommerziellen Druck. Sutskever übernahm den Posten des CEO, nachdem der Mitgründer Daniel Gross zu Meta gewechselt war, weil er dort einen Berg von Geld bekam, und die KI-Sicherheit sofort in den Hintergrund trat... Das Start-up vertritt einen alternativen Ansatz für die KI-Entwicklung, bei dem die Sicherheit Vorrang vor der Geschwindigkeit der Markteinführung hat, mit dem Ziel, die Anpassungsprobleme zu vermeiden, die aktuelle Systeme plagen. Eine so hohe Bewertung für ein Start-up, das “langsam” vorgehen will, während alle anderen rennen (wohin?), ist nur der Tatsache geschuldet, dass Ilya Sutskever als CEO fungiert, aber warum ist er ein so großer Name?